-

你们最爱的微信表情包,到了 VR 时代会变成什么样?

为何需要一种新格式?

互联网时代的表情包或者是静态的 jpg,或者是动态的 gif。

人类进入 VR 时代后,打开 WeChatVR,输入的表情包也得是真三维的内容,转个身能看到不一样的风景。比如这样:

-

Vulkan 很酷很炫,但是不适合你

如果你属于以下几类人,那么别浪费时间在 Vulkan 上了:

- 国内大学生

- 不懂 OpenGL 或 D3D 的程序员

- 用 cocos 和 unity 的程序员

- iPhone、Mac 程序员

- Windows 游戏程序员

- Windows 应用程序员

- Web 程序员

-

计算机视觉、图形学和图像处理,三者有什么联系?

先说区别

Computer Graphics,简称 CG

输入的是对虚拟场景的描述,通常为多边形数组,而每个多边形由三个顶点组成,每个顶点包括三维坐标、贴图坐标、rgb 颜色等。输出的是图像,即二维像素数组。

[xyz xyz xyz ... xyz] -> 图片Computer Vision,简称 CV

输入的是图像或图像序列,通常来自相机、摄像头或视频文件。输出的是对于图像序列对应的真实世界的理解,比如检测人脸、识别车牌、区分猫狗。

图片 -> dog or cat? 图片 -> [xyz xyz xyz ... xyz]

-

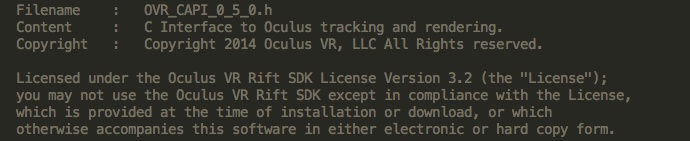

#纯干货#加速 VR 渲染地狱难度进阶篇之降低图形 API 调用次数

准备好,中文互联网终于有人开始严肃地讨论 VR 技术了。纯干货文章,直奔主题。

VR 渲染的难点是什么?

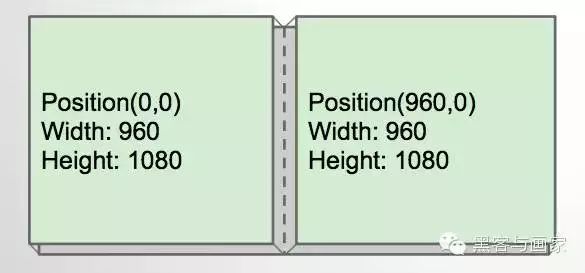

左眼和右眼看到的场景是不同的,因此同样的 API 需要调用两次。以 Oculus DK2 为例,头戴显示器分辨率为 1920 X 1080,viewport 均分为左右两部分,各为 960 X 1080。这意味着 CPU 和 GPU 的工作量相比传统三维游戏都要增加,如何降低额外的一次绘制的开销是这篇文章的重点。

VR 地狱有几层?

先来四层:

- 整个场景画两次:先绘制左眼看到的场景,然后绘制右眼看到的场景。

- 每个物体画两次:对于场景中的物体依次绘制,物体 1 左眼 -> 物体 1 右眼 -> 物体 2 左眼 -> 物体 2 右眼 -> 按照左右左右的顺序绘制。

- 硬件 Geometry Shader 技术:只绘制一次,用硬件 Geometry Shader 生成左右两个场景。

- 硬件 Instancing 技术:只绘制一次,用 instancing 技术生成左右两个场景。

-

花150元淋10分钟雨?在你的朋友圈将被“雨屋”刷爆前,知道这些会让你更酷

你打算花 150 元排 3 小时队只为淋 10 分钟雨?小张的这篇文章让你排队的时候多点谈资。这次分享的是关于九月份即将引爆上海滩和朋友圈的《雨屋》,也就是题图中的场景。

将覆盖以下技术点:

- 《雨屋》是什么?

- 输入部分使用什么传感器?

- 处理部分怎么编程?

- 如何合并多个传感器的结果?

- 这项技术还能应用到什么场景?

Recent Posts

- [中译] Sam Altman - What I Wish Someone Had Told Me

- Awesome Omniverse Documents

- taptap / pkg-doctor 更新,支持苹果游戏包体

- 《光线追踪精粹》译者序

- 你对手游包体的大小感到焦虑吗?试试 TapTap 的这款开源软件

- 大力出奇迹的《赛博朋克 2077》,为了 RTX 竟将整个城市塞进一个盒子

- 《光线追踪精粹》翻译周报 2019-08-07 文末有彩蛋

- 《光线追踪精粹》翻译周报 2019-04-23

- 老黄不食言,Ray Tracing Gems 全家桶现已免费送出

- 奔四的不只有 Vinjn,还有 OpenCV

Tags